生成AIの普及に伴い、「プロンプト」が注目されています。AIに答えを出してもらうための「指示文」というような意味のようですが、適切な問いを考え、指示を出すというスキルは、AIが相手じゃなくても必要なスキルになってくると思います。

「プログラミング」よりも「プロンプト」?

2023年9月9日号の週刊ダイヤモンドで、ChatGPTに使えるプロンプトの特集が組まれていました。それによると、プロンプトとは、以下のような意味になります。

ChatGPTに指示を与えるために入力する文章のことを「プロンプト(指示文)」と呼ぶ。このプロンプトの巧拙次第で、AIによる解答の質が左右される。

雑誌でも特集が組まれるくらいに「プロンプト」が注目されています。AI時代には、プログラミングよりもプロンプトの精度を高める「プロンプトエンジニアリング」の方が重要ではないかともいわれています。

人間が普段話すような言葉でChatGPTに質問をしても、それなりに良い答えを返してくれますが、そこからさらに工夫して、AIが読みやすい形式で質問をすると、さらに筋の良い、自分が求めているものに近い答えを出力するようになります。

例えば、日本で一番広い湖を検索する場合、人間が普段話すような質問の仕方だと、以下のような例になることがあります。

日本の湖のことが知りたいと思っていても、プロンプトでそのことを指定しないと、世界の湖の情報が出てしまいます。また、何をもって「一番広い」というのかの指定もないので、「中国で一番広い湖」の情報なども出てきてしまいます。

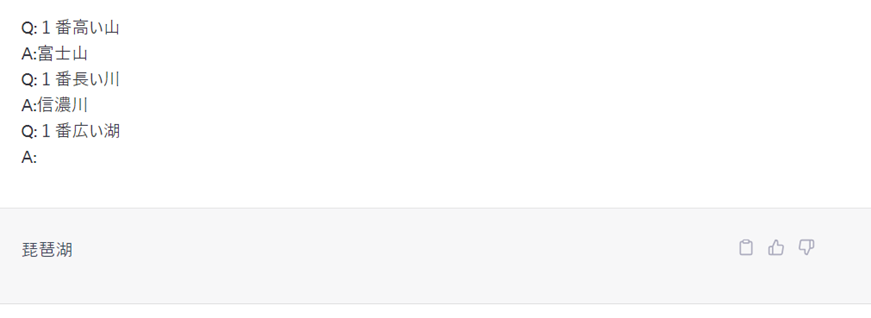

これを、もっと端的に日本の情報だけを知りたい場合、以下のようにプロンプトを設定します。

上記のように回答サンプルを指定すれば、すぐに「琵琶湖」という答えを返してくれます。

このように、AIが読み取りやすい指示を送ることが、ChatGPTを使いこなすにあたっては重要になります。

自分が知りたいような回答をしてくれないからといって、「ChatGPTが使えない」とか、「ChatGPTが間違っている」と考えてはいけません。間違っている可能性もあるかもしれませんが、そもそもの指示の仕方が悪い可能性もあります。

答えを出すことよりも、適切な指示を出せるかどうかが重要になっている

ビジネス書の名著「イシューからはじめよ」には、コンサルタントなどの知的職業において必要なのは問題解決力や思考法だけでなく、「何に答えを出すべきなのか」を見極めることの重要性を説明しています。

生成AI普及により、今後さらに「問題解決」自体はAIが担う部分が増えてくるかもしれません。

AIを使いこなせるかが質の高いアウトプットには必要であり、そのAIを使いこなせるかは「プロンプト」の巧拙に左右されます。答えを出すことよりも、適切な指示を出せるかどうかの方が重要になってくるでしょう。

AIは人間のように受け答えをしてくれますが、人間ではありません。AIが答えやすいような言葉で話しかけることが、AI時代には必要となってきます。

対AIじゃなくても、適切な指示を出すスキルは求められてくる

一方で、適切な指示を出すスキルというのは、何もAIに対してだけではなく、人間同士のコミュニケーションでも重要だとも思います。

部下を持つ管理職は、「部下が成長してくれない」とか「言われたことしかやろうとしない」といって愚痴をこぼしますが、それは、そもそも上司の部下に対する「プロンプト」が悪いのかもしれません。

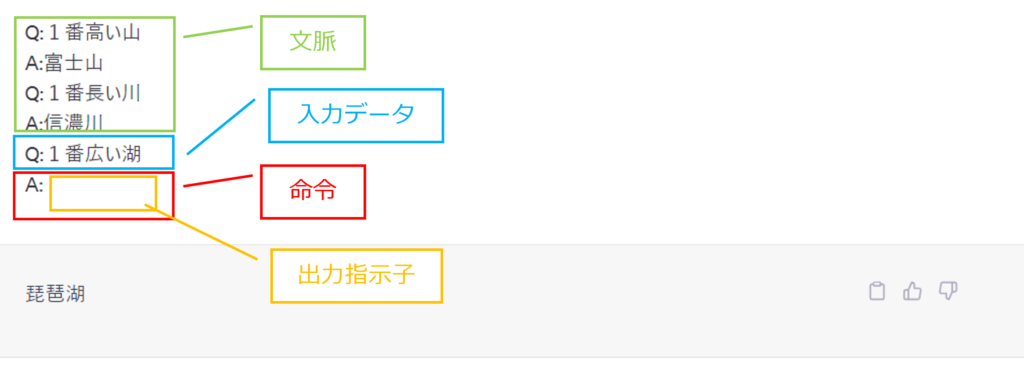

「プロンプトエンジニアリング」を養成するためのガイドである「Prompt Engineering Guide」によれば、プロンプトには以下の4つの要素が重要になるとあります。

命令 – モデルに実行してほしい特定のタスクまたは命令

文脈 – 外部情報や追加の文脈が含まれる場合があり、モデルをより良い応答に導くことができます。

入力データ – 応答を見つけたい入力または質問

出力指示子 – 出力のタイプや形式を示します。

先ほどの湖の例だと、4つの要素は上記が該当します。

このようなプロンプトにおける要素は、人間同士のコミュニケーションにおいても重要ではないでしょうか。

できるだけ不正確さを避け、何を答えてほしいのか、どういう形式で答えてほしいのかを明確に指示を出せば、指示を受ける方も無駄な作業が減り、指示を出した者が求めるアウトプットを出せる可能性は高まります。

部下を持つ管理職の人は、自分が思った成果物が上がってこない場合、まず自分の指示の出し方がまずかったんじゃないかというところから自省することが必要かもしれません。